Integracja sztucznej inteligencji (AI) z praktykami w obszarze zasobów ludzkich (HR) w całej Europie szybko przekształca krajobraz operacyjny, niosąc ze sobą zarówno bezprecedensowe możliwości, jak i złożone wyzwania regulacyjne. Potencjał AI do zrewolucjonizowania funkcji HR – od automatyzacji procesów rekrutacyjnych i usprawnienia zarządzania wynikami, po personalizację rozwoju pracowników i poprawę efektywności operacyjnej – jest niezaprzeczalny. Jednak tak szybkie wdrażanie wymaga dogłębnego zrozumienia złożonych ram regulacyjnych dotyczących AI, aby zapewnić zgodność i etyczne wdrożenie.

Dla europejskich specjalistów HR kluczowe znaczenie mają Ogólne rozporządzenie o ochronie danych (RODO) oraz nadchodzący Europejski Akt o Sztucznej Inteligencji (AI Act). RODO, obowiązujące od 2018 roku, ustanawia rygorystyczne zasady przetwarzania danych osobowych, w tym danych pracowników i kandydatów do pracy. AI Act, którego etapowe wdrażanie rozpocznie się w lutym 2025 roku, wprowadza specyficzną warstwę regulacyjną dotyczącą systemów AI w zależności od poziomu ich potencjalnego ryzyka. Ponieważ zastosowania AI w HR często obejmują przetwarzanie danych osobowych i nierzadko klasyfikowane są jako „wysokiego ryzyka” w ramach AI Act, menedżerowie HR muszą uważnie poruszać się w obszarze wzajemnych powiązań między tymi dwiema regulacjami.

Ten wpis na blogu stanowi kompleksowy przewodnik dla europejskich menedżerów HR, koncentrując się na rozszyfrowaniu zapisów AI Act, zapewnieniu zgodności z RODO w kontekście AI, zrozumieniu rozwoju i potencjału sztucznej inteligencji w HR, identyfikacji strategicznych inwestycji, nawigowaniu po nieodłącznych wyzwaniach i ryzykach oraz przedstawieniu najlepszych praktyk w zakresie odpowiedzialnego wdrażania AI.

Odszyfrowanie Europejskiego Aktu o Sztucznej Inteligencji w kontekście zastosowań HR

Europejski Akt o Sztucznej Inteligencji (AI Act) przyjmuje podejście oparte na analizie ryzyka w celu regulowania sztucznej inteligencji, klasyfikując systemy AI w zależności od ich potencjalnej szkodliwości. Ten hierarchiczny system klasyfikacji – obejmujący poziomy od ryzyka niedopuszczalnego po minimalne lub żadne – bezpośrednio określa poziom kontroli regulacyjnej oraz szczególne obowiązki spoczywające zarówno na dostawcach, jak i użytkownikach tych systemów, takich jak działy HR. Zrozumienie tego podejścia opartego na ryzyku jest kluczowe dla menedżerów HR podczas oceny i wdrażania różnych narzędzi AI.

AI Act dzieli systemy sztucznej inteligencji na cztery główne poziomy ryzyka, z których każdy ma odrębne konsekwencje dla HR:

Systemy AI zabronione

Na najwyższym poziomie znajdują się systemy AI uznane za stwarzające niedopuszczalne ryzyko dla praw podstawowych i dlatego zakazane. W kontekście HR do tej kategorii należą systemy służące do społecznego punktowania pracowników lub kandydatów na podstawie ich zachowań społecznych czy cech osobistych niezwiązanych z pracą. Ponadto Akt zakazuje stosowania systemów AI zaprojektowanych do rozpoznawania emocji w miejscu pracy, z bardzo ograniczonymi wyjątkami dotyczącymi celów medycznych lub bezpieczeństwa.

Zakaz ten ma poważne konsekwencje dla narzędzi HR, które mogłyby analizować mimikę twarzy, wzorce głosu czy nawet sposób pisania na klawiaturze w celu oceny przydatności kandydata lub monitorowania zaangażowania pracowników. Menedżerowie HR muszą zachować szczególną ostrożność, aby nie wdrażać technologii AI objętych zakazem, gdyż grożą za to wysokie kary.

Systemy AI wysokiego ryzyka

Kolejną kategorię stanowią systemy AI wysokiego ryzyka. Co istotne, AI Act jednoznacznie klasyfikuje systemy AI przeznaczone do zastosowań w obszarze zatrudnienia i zarządzania pracownikami jako wysokiego ryzyka. Obejmuje to m.in. systemy stosowane w procesach rekrutacji i selekcji, podejmujące decyzje wpływające na relacje zawodowe (takie jak awans czy zwolnienie), przydzielające zadania na podstawie zachowań lub cech osobistych, a także służące do monitorowania i oceny wyników pracy. Ponieważ funkcje te stanowią trzon działalności HR, większość rozwiązań AI w tych obszarach prawdopodobnie zostanie uznana za wysokiego ryzyka, co wiąże się z koniecznością spełnienia rygorystycznych wymogów zgodności.

Systemy AI o ograniczonym ryzyku

Systemy AI o ograniczonym ryzyku podlegają określonym wymogom w zakresie przejrzystości. Przykładem istotnym dla HR są chatboty wykorzystywane do obsługi zapytań pracowników. W takich przypadkach AI Act nakazuje wyraźne informowanie użytkowników, że mają do czynienia z systemem AI. Zapewnia to przejrzystość i pozwala osobom w pełni zrozumieć charakter interakcji.

Systemy AI o minimalnym lub żadnym ryzyku

Ostatnią kategorię stanowią systemy AI o minimalnym lub żadnym ryzyku, takie jak filtry antyspamowe czy gry wideo oparte na AI. Ze względu na znikomy potencjał naruszania praw podstawowych, systemy te zasadniczo nie podlegają żadnym szczególnym wymogom regulacyjnym określonym w AI Act.

Obowiązki dotyczące systemów AI wysokiego ryzyka w HR

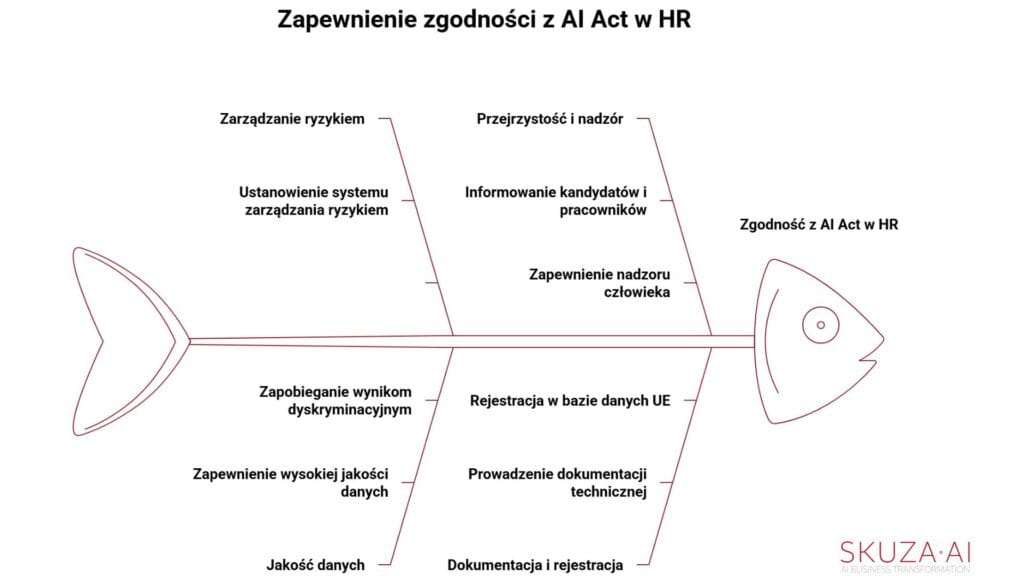

Dla działów HR wdrażających systemy sztucznej inteligencji zaklasyfikowane jako wysokiego ryzyka, Akt o Sztucznej Inteligencji (AI Act) nakłada szeroki zestaw obowiązków:

System zarządzania ryzykiem – ustanowienie i utrzymywanie solidnego systemu zarządzania ryzykiem przez cały cykl życia systemu AI.

Jakość danych – zapewnienie, że dane wykorzystywane do trenowania systemu AI są wysokiej jakości, istotne i wystarczająco reprezentatywne, aby zapobiegać wynikom dyskryminacyjnym.

Dokumentacja techniczna – prowadzenie kompleksowej dokumentacji technicznej systemu AI, opisującej jego funkcjonalności oraz zgodność z wymogami Aktu.

Przejrzystość – informowanie kandydatów i pracowników o korzystaniu z systemu AI wysokiego ryzyka, wyjaśnianie jego działania oraz sposobu podejmowania decyzji.

Nadzór człowieka – zapewnienie odpowiedniego nadzoru ludzkiego nad funkcjonowaniem systemu, aby zagwarantować sprawiedliwość i dokładność podejmowanych decyzji.

Rejestrowanie działań – prowadzenie logów dotyczących wykorzystania systemu AI, przetwarzanych danych oraz przypadków rozpoznawania pracowników przez system.

Rejestracja w unijnej bazie danych – obowiązek rejestracji systemów AI wysokiego ryzyka w bazie danych UE.

Oceny zgodności – przeprowadzanie ocen zgodności w celu wykazania spełnienia wymogów przed wprowadzeniem systemu na rynek lub rozpoczęciem jego użytkowania.

Ciągłe monitorowanie – monitorowanie działania systemu w sposób ciągły, aby identyfikować pojawiające się ryzyka.

Odporność i dokładność – projektowanie systemu w sposób zapewniający odpowiednią odporność i dokładność w odniesieniu do zamierzonego zastosowania.

Zakres i szczegółowość tych obowiązków podkreślają znaczące inwestycje w procesy i technologie, jakie działy HR będą musiały poczynić, aby zapewnić zgodność podczas korzystania z systemów AI wysokiego ryzyka w swojej działalności.

Zakazane praktyki w miejscu pracy

Poza obowiązkami dotyczącymi systemów wysokiego ryzyka, Akt o Sztucznej Inteligencji (AI Act) ma również bezpośrednie konsekwencje dla praktyk, które są całkowicie zakazane w środowisku pracy. Jak wspomniano wcześniej, systemy rozpoznawania emocji, które w miejscu pracy wnioskują o stanie emocjonalnym na podstawie danych biometrycznych, są w dużej mierze zabronione. Zakaz ten obejmuje analizę mimiki twarzy, wzorców głosu lub innych danych biometrycznych w celu wykrywania emocji, takich jak stres, zadowolenie czy zaangażowanie. Podobnie, zabronione jest wykorzystywanie AI do społecznego punktowania pracowników lub kandydatów na podstawie ich zachowań społecznych lub cech niezwiązanych bezpośrednio z ich wynikami pracy. Menedżerowie HR muszą być także świadomi zakazu stosowania manipulacyjnych lub wprowadzających w błąd technik AI, które mogłyby zniekształcać zachowanie jednostki bez jej świadomości. Proaktywna identyfikacja i eliminacja wszelkich istniejących lub planowanych aplikacji AI należących do tych zakazanych kategorii jest kluczowa, aby uniknąć poważnych konsekwencji prawnych i finansowych.

Przejrzystość, dokumentacja i nadzór człowieka

Przejrzystość, dokumentacja i nadzór człowieka to wymagania przekrojowe w ramach AI Act, które są szczególnie istotne dla zastosowań HR. Działy HR muszą zapewnić przejrzystość poprzez dokładne dokumentowanie procesów związanych z AI i udostępnianie istotnych informacji pracownikom. Konieczne jest także prowadzenie szczegółowych zapisów dotyczących wszystkich działań związanych ze zgodnością z AI Act. Ponadto, niezwykle ważne jest wdrożenie solidnych mechanizmów umożliwiających ludzką kontrolę i interwencję w decyzje podejmowane lub wspierane przez systemy AI. Wymogi te podkreślają intencję ustawodawcy, by zagwarantować wyjaśnialność AI w HR i utrzymać nadrzędną rolę człowieka w podejmowaniu istotnych decyzji wpływających na kariery pracowników.

Kompetencje cyfrowe w zakresie AI (AI literacy)

AI Act kładzie także duży nacisk na znaczenie podnoszenia kompetencji w zakresie AI wewnątrz organizacji. Pracodawcy są zobowiązani do zapewnienia, aby pracownicy działów HR oraz inne osoby korzystające z systemów AI posiadali odpowiedni poziom wiedzy o AI, dostosowany do ich ról oraz kontekstu, w jakim system jest używany. Wymaga to wdrożenia kompleksowych programów szkoleniowych dotyczących AI Act, które wyposażą specjalistów HR w niezbędną wiedzę i umiejętności pozwalające skutecznie zarządzać i nadzorować systemy AI, a także rozumieć prawne i etyczne konsekwencje ich stosowania.

Zgodność z RODO w erze HR opartym na AI

Jeszcze przed wejściem w życie AI Act, Ogólne rozporządzenie o ochronie danych (RODO) ustanowiło kompleksowe ramy dotyczące przetwarzania danych osobowych w Unii Europejskiej. Podstawowe zasady RODO pozostają nadal bardzo istotne i znajdują bezpośrednie zastosowanie w kontekście korzystania z AI w HR, stanowiąc fundament zgodnego z prawem wdrażania tych technologii.

Zasady takie jak zgodność z prawem, rzetelność i przejrzystość wymagają, aby każde przetwarzanie danych osobowych przez systemy AI miało uzasadnioną podstawę prawną, odbywało się w sposób uczciwy i było przejrzyste dla osób, których dane są przetwarzane. Obejmuje to obowiązek przekazywania jasnych informacji na temat sposobu wykorzystywania systemów AI oraz celów, dla których przetwarzane są dane pracowników. Zasada minimalizacji danych nakazuje, aby działy HR gromadziły i przetwarzały wyłącznie te dane osobowe, które są absolutnie niezbędne do realizacji określonych celów aplikacji AI. Ponadto RODO podkreśla znaczenie dokładności danych, co oznacza, że dane wykorzystywane do trenowania i działania systemów AI muszą być poprawne i aktualne. Te podstawowe zasady powinny kierować każdym etapem wdrażania AI w HR, aby zapewnić zgodność z wymogami RODO.

Podstawy prawne przetwarzania danych pracowniczych

Poruszanie się po podstawach prawnych przetwarzania danych pracowników przy korzystaniu z AI może być skomplikowane, zwłaszcza w kontekście zgody. Choć zgoda jest jedną z podstaw prawnych przetwarzania danych osobowych zgodnie z RODO, jej ważność w relacji pracodawca–pracownik bywa kwestionowana ze względu na naturalną nierównowagę sił między stronami. Aby zgoda była ważna, musi być dobrowolna, konkretna, świadoma i jednoznaczna. Z uwagi na możliwość odczuwania presji w relacji pracowniczej, opieranie się wyłącznie na zgodzie jako podstawie prawnej dla procesów HR opartych na AI może być problematyczne.

Dlatego działy HR powinny starannie rozważać alternatywne podstawy prawne, takie jak:

przetwarzanie niezbędne do wykonania umowy (np. wykorzystanie AI do obsługi płac lub organizacji kluczowych procesów pracy),

przetwarzanie oparte na uzasadnionym interesie pracodawcy.

W tym ostatnim przypadku konieczne jest przeprowadzenie ścisłego testu równowagi, aby upewnić się, że interesy pracodawcy nie przeważają nad podstawowymi prawami i wolnościami pracowników.

Zautomatyzowane podejmowanie decyzji

Artykuł 22 RODO przyznaje osobom fizycznym prawo do tego, aby nie podlegały decyzji opartej wyłącznie na zautomatyzowanym przetwarzaniu, w tym profilowaniu, która wywołuje wobec nich skutki prawne lub w podobny sposób znacząco na nie wpływa. Ten przepis ma istotne konsekwencje dla procesów HR wykorzystujących podejmowanie decyzji w oparciu o AI, szczególnie w obszarach takich jak rekrutacja czy zwolnienia. Całkowicie zautomatyzowane podejmowanie decyzji w tych kluczowych obszarach jest zasadniczo ograniczone, chyba że mają zastosowanie określone wyjątki – np. wyraźna zgoda lub upoważnienie na mocy prawa z odpowiednimi zabezpieczeniami. Aby zapewnić zgodność z artykułem 22, działy HR korzystające z AI w procesach decyzyjnych muszą wdrożyć odpowiednie środki ochronne, w tym: zagwarantować udział człowieka w procesie decyzyjnym, zapewnić pracownikom możliwość wyrażenia własnej opinii oraz zaoferować mechanizm umożliwiający zakwestionowanie decyzji podjętych automatycznie.

Ocena skutków dla ochrony danych (DPIA)

W przypadku wdrażania systemów AI przetwarzających dane osobowe – szczególnie tych zaklasyfikowanych jako wysokiego ryzyka w ramach AI Act – działy HR są zobowiązane do przeprowadzenia oceny skutków dla ochrony danych (Data Protection Impact Assessment, DPIA). DPIA to proces mający na celu identyfikację i ocenę potencjalnych zagrożeń dla praw i wolności osób wynikających z przetwarzania ich danych osobowych. Ocena ta pomaga organizacjom zrozumieć możliwe konsekwencje związane z ochroną danych w kontekście stosowania systemów AI oraz wdrożyć odpowiednie środki minimalizujące zidentyfikowane ryzyka. Co istotne, AI Act wymaga, aby podczas przeprowadzania DPIA dla systemów wysokiego ryzyka użytkownicy (np. działy HR) korzystali z informacji, które dostawca systemu AI jest zobowiązany zapewnić zgodnie z AI Act. Gwarantuje to pełną i świadomą ocenę ryzyka.

Bezpieczeństwo i zarządzanie danymi

Zapewnienie solidnego bezpieczeństwa danych oraz skutecznego zarządzania nimi ma kluczowe znaczenie dla zgodności z RODO przy korzystaniu z AI w HR. Działy HR muszą wdrożyć silne środki techniczne i organizacyjne chroniące dane pracowników przed nieuprawnionym dostępem, przetwarzaniem czy utratą. Obejmuje to m.in. szyfrowanie, kontrolę dostępu oraz regularne audyty bezpieczeństwa. Ponadto niezbędne jest ustanowienie jasnych procedur zarządzania danymi, które zagwarantują jakość, reprezentatywność i aktualność danych wykorzystywanych przez systemy AI. Ważnym elementem zgodności z RODO pozostaje również zasada minimalizacji danych – gromadzenie i przechowywanie wyłącznie tych informacji, które są niezbędne do realizacji konkretnych celów aplikacji AI.

Trajektoria rozwoju AI w europejskim HR

Wdrażanie sztucznej inteligencji w HR w Europie nie jest wizją przyszłości, lecz szybko rozwijającą się rzeczywistością, o czym świadczą aktualne statystyki i nowe trendy. Ostatnie badania wskazują na znaczący wzrost wykorzystania AI wśród specjalistów HR. Znaczna część europejskich firm wdrożyła już AI w co najmniej jednej funkcji HR, a dane sugerują, że niemal trzech na czterech pracodawców korzysta z AI w swoich procesach HR. Oznacza to przejście z etapu wstępnych eksperymentów do coraz bardziej ugruntowanego wykorzystania technologii AI w działach HR. Warto jednak zauważyć, że tempo adopcji różni się w zależności od kraju – państwa nordyckie i regiony kontynentalne wykazują wyższy poziom integracji AI niż kraje Europy południowej i południowo-zachodniej.

Patrząc w przyszłość, rola AI w europejskim HR ma wzrosnąć jeszcze bardziej, stając się kluczowym elementem transformacji HR oraz strategii zarządzania talentami. Eksperci przewidują dalszy wzrost wykorzystania AI w sektorze HR, z dużym potencjałem do automatyzacji rutynowych i administracyjnych zadań. Ewolucja ta wskazuje na przyszłość, w której AI będzie pełniła coraz bardziej strategiczną i centralną rolę w sposobie funkcjonowania i zarządzania procesami HR.

Aktualne zastosowania AI w HR

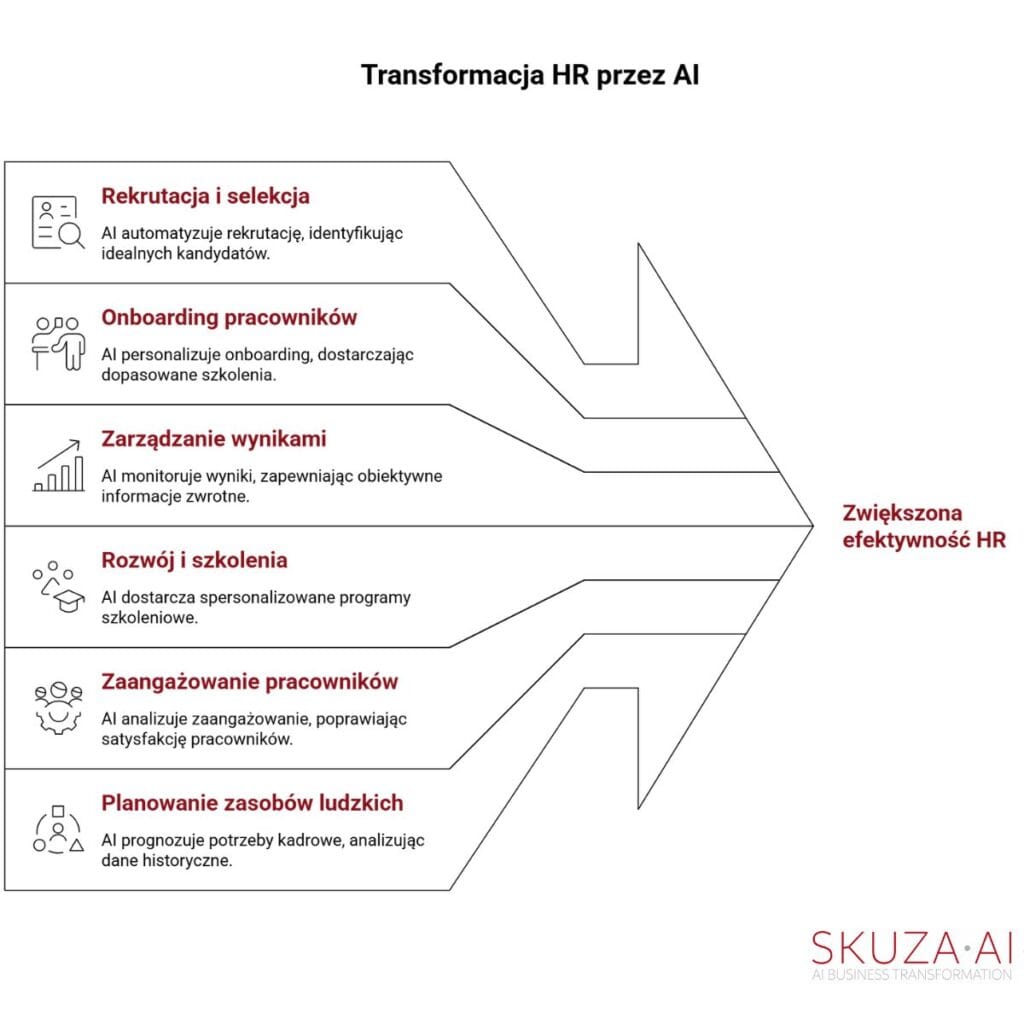

Obecnie sztuczna inteligencja przynosi znaczną wartość w szerokim zakresie funkcji HR:

Rekrutacja i selekcja kandydatów – narzędzia AI automatyzują analizę CV, identyfikują idealnych kandydatów na podstawie zdefiniowanych kryteriów oraz usprawniają cały proces pozyskiwania talentów.

Onboarding pracowników – procesy oparte na AI personalizują programy wdrożeniowe i dostarczają dopasowane moduły szkoleniowe dla nowych pracowników.

Zarządzanie wynikami i informacja zwrotna – AI umożliwia ciągłe monitorowanie, zapewnia informacje zwrotne w czasie rzeczywistym oparte na obiektywnych danych, a nawet może przewidywać trendy wydajności.

Rozwój i szkolenia pracowników – platformy edukacyjne wykorzystujące AI oceniają umiejętności i preferencje, aby dostarczać spersonalizowane programy szkoleniowe.

Zaangażowanie pracowników – AI analizuje wyniki ankiet dotyczących zaangażowania, dostarczając cennych informacji o satysfakcji pracowników i obszarach wymagających poprawy.

Planowanie zasobów ludzkich i analityka predykcyjna – AI pomaga organizacjom prognozować przyszłe potrzeby kadrowe poprzez analizę danych historycznych i trendów rynkowych.

Zarządzanie talentami – systemy AI wspierają identyfikację i rozwój talentów w organizacji, wspomagając decyzje dotyczące awansów i ścieżek kariery.

Analiza wynagrodzeń i świadczeń – AI optymalizuje analizę wynagrodzeń i benefitów poprzez badanie trendów rynkowych i danych o wynikach pracowników.

Chatboty HR i platformy samoobsługowe – rozwiązania oparte na AI zapewniają natychmiastowe odpowiedzi na pytania pracowników i usprawniają dostęp do informacji HR.

Te udane zastosowania pokazują szeroką użyteczność AI w zwiększaniu efektywności, personalizacji oraz podejmowaniu decyzji opartych na danych w obszarze HR.

Ewoluujący krajobraz technologii HR

Krajobraz technologii HR przechodzi obecnie dynamiczną transformację, w której sztuczna inteligencja staje się coraz bardziej zintegrowanym elementem wielu rozwiązań. Coraz szerzej dostępne są platformy i narzędzia HR oparte na AI, zaprojektowane tak, aby odpowiadać na różnorodne potrzeby działów personalnych. Ta ewolucja technologiczna napędza także przejście w kierunku zarządzania talentami opartego na kompetencjach, gdzie AI odgrywa kluczową rolę w identyfikacji luk kompetencyjnych i dopasowywaniu talentów do możliwości na podstawie ich umiejętności, a nie jedynie stanowisk. Ponadto duży nacisk kładzie się na wykorzystanie AI w celu poprawy doświadczeń pracowników, poprzez bardziej spersonalizowane i efektywne usługi oraz wsparcie HR. Ten ewoluujący krajobraz podkreśla konieczność, aby menedżerowie HR byli na bieżąco z najnowszymi osiągnięciami technologii HR opartych na AI, aby skutecznie wykorzystywać ich potencjał.

Inwestycje strategiczne w zgodne z prawem wdrożenie AI

Aby skutecznie wdrożyć AI w europejskich działach HR, przy jednoczesnym zachowaniu zgodności z wymogami RODO i AI Act, menedżerowie HR muszą dokonać strategicznych inwestycji w kilku kluczowych obszarach. Inwestycje te nie tylko ułatwią adaptację AI, lecz także zapewnią zgodność i wesprą etyczne praktyki.

Platformy i narzędzia HR oparte na AI

Jednym z kluczowych obszarów inwestycji są platformy i narzędzia HR wspierane przez AI. Obejmuje to wybór i wdrożenie rozwiązań odpowiadających na potrzeby organizacji w zakresie rekrutacji, zarządzania wynikami, rozwoju i szkoleń czy zaangażowania pracowników. Proces wyboru musi jednak wykraczać poza samą funkcjonalność – menedżerowie HR powinni priorytetowo traktować dostawców, którzy wykazują silne zaangażowanie w przestrzeganie regulacji, szczególnie RODO i AI Act. Oznacza to upewnienie się, że wybrane narzędzia posiadają solidne mechanizmy ochrony danych, że ich algorytmy są możliwie przejrzyste i wyjaśnialne, a dostawcy zapewniają odpowiednią dokumentację i wsparcie w działaniach związanych z zapewnieniem zgodności.

Programy szkoleniowe dla specjalistów HR

Kolejną niezbędną inwestycją są kompleksowe programy szkoleniowe dla profesjonalistów HR. W miarę jak AI staje się integralną częścią procesów HR, konieczne jest, aby zespoły personalne rozumiały podstawy technologii AI, konsekwencje wynikające z RODO i AI Act oraz najlepsze praktyki etycznego i odpowiedzialnego korzystania z tych narzędzi. Szkolenia powinny obejmować zagadnienia takie jak prywatność danych, uprzedzenia algorytmiczne, wymogi przejrzystości oraz znaczenie nadzoru człowieka. Wyposażenie specjalistów HR w tę wiedzę umożliwi im skuteczny nadzór nad systemami AI, podejmowanie świadomych decyzji dotyczących ich wdrożenia i zapewnianie zgodności z ewoluującymi regulacjami.

Ekspertyza prawna i zgodności

Ze względu na złożoność ram prawnych regulujących AI w HR, szczególnie interakcję między RODO a AI Act, warto inwestować w wiedzę prawną i compliance. Współpraca z prawnikami lub ekspertami ds. zgodności specjalizującymi się w ochronie danych i regulacjach dotyczących AI w Europie może dostarczyć nieocenionych wskazówek w poruszaniu się po tych wymaganiach. Ich wiedza pozwoli upewnić się, że wdrożenia AI są zgodne z prawem, potencjalne ryzyka zostaną wcześnie zidentyfikowane i zminimalizowane, a organizacja pozostanie w zgodzie z regulacjami, ograniczając ryzyko kar.

Infrastruktura i protokoły bezpieczeństwa danych

Kluczowym obszarem inwestycji jest także solidna infrastruktura bezpieczeństwa danych i odpowiednie protokoły. Systemy AI w HR często przetwarzają duże ilości wrażliwych danych pracowników i kandydatów, dlatego wzmocnienie środków bezpieczeństwa ma ogromne znaczenie. Obejmuje to technologie i procesy takie jak szyfrowanie danych, ścisła kontrola dostępu, mechanizmy zapobiegania utracie danych czy regularne audyty bezpieczeństwa – wszystko to wymagane jest także przez RODO.

Należyta staranność wobec dostawców AI

Przy wyborze dostawców AI menedżerowie HR muszą dochować należytej staranności, aby upewnić się, że są oni zgodni z europejskimi regulacjami. Obejmuje to wybór dostawców z silnym dorobkiem w zakresie ochrony danych i przestrzegania RODO oraz AI Act. Niezwykle ważne jest także ocenianie przejrzystości i wyjaśnialności algorytmów, aby procesy decyzyjne były zrozumiałe. Dostawcy powinni zapewniać szczegółową dokumentację i adekwatne wsparcie, które ułatwią działom HR spełnienie wymogów. Weryfikacja praktyk bezpieczeństwa dostawców jest kluczowa dla ochrony wrażliwych danych pracowniczych.

Nawigowanie po wyzwaniach i ryzykach AI w HR

Choć AI oferuje liczne korzyści dla HR, jej wdrożenie wiąże się także z szeregiem wyzwań i ryzyk, które europejscy menedżerowie HR muszą proaktywnie adresować.

Etyka i uprzedzenia algorytmiczne – algorytmy uczą się na danych, a jeśli dane odzwierciedlają istniejące uprzedzenia społeczne lub organizacyjne, systemy AI mogą je utrwalać i wzmacniać, prowadząc do dyskryminacyjnych wyników w rekrutacji czy ocenie wyników pracy. Konieczne jest stosowanie różnorodnych i reprezentatywnych danych treningowych oraz regularne audyty algorytmów pod kątem sprawiedliwości.

Nadzór człowieka – AI nie powinna całkowicie zastępować ludzkiego osądu w krytycznych sprawach HR wpływających na kariery pracowników. Profesjonaliści HR muszą mieć możliwość weryfikowania, korygowania i ingerowania w decyzje generowane przez AI. Unikanie całkowicie zautomatyzowanego podejmowania decyzji w obszarach takich jak rekrutacja czy zwolnienia ma kluczowe znaczenie dla zapewnienia odpowiedzialności.

Sprawiedliwość, odpowiedzialność i przejrzystość – wszystkie zastosowania AI w HR muszą spełniać standardy etyczne. Działy HR powinny zapewnić sprawiedliwość przy projektowaniu i wdrażaniu systemów AI, jasno określić odpowiedzialność za decyzje podejmowane przez te systemy oraz utrzymywać przejrzystość dotyczącą ich działania.

Zarządzanie zaufaniem pracowników – wprowadzenie AI w miejscu pracy może budzić opór i brak zaufania pracowników, szczególnie w kontekście prywatności czy obaw o miejsca pracy. Menedżerowie HR muszą komunikować się otwarcie i przejrzyście na temat roli AI, jej wpływu na bezpieczeństwo zatrudnienia oraz stosowanych środków ochrony danych. Aktywne zaangażowanie i dialog z pracownikami są kluczowe dla budowania zaufania i zapewnienia powodzenia wdrożeń AI w HR.

Najlepsze praktyki odpowiedzialnego wdrażania AI w europejskim HR

Aby sprostać złożoności wdrażania sztucznej inteligencji w HR w Europie, przy jednoczesnym zachowaniu zgodności z RODO i AI Act, menedżerowie HR powinni przyjąć zestaw najlepszych praktyk, które promują odpowiedzialne i etyczne korzystanie z tej technologii.

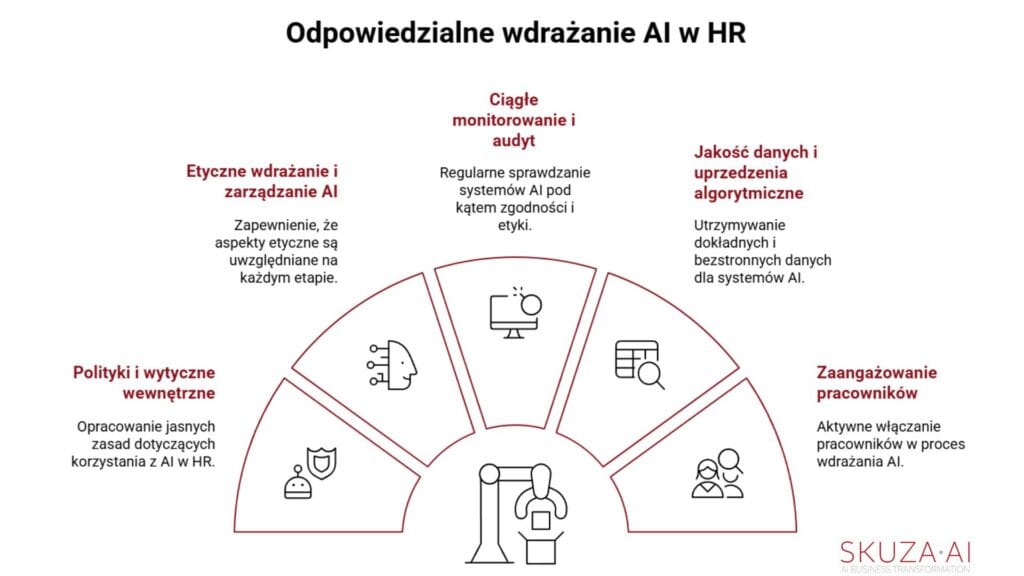

Polityki i wytyczne wewnętrzne

Opracowanie jasnych polityk i wytycznych dotyczących korzystania z AI to podstawowy krok. Powinny one określać zasady odpowiedzialnego wykorzystania AI zgodne z zasadami etycznymi i wymaganiami regulacyjnymi, precyzować reguły dotyczące stosowania AI w różnych procesach HR oraz zapewniać, że wszyscy pracownicy są świadomi tych zasad i je rozumieją.

Etyczne wdrażanie i zarządzanie AI

Kluczowe jest także stworzenie ram etycznego wdrażania i nadzoru nad AI. Obejmuje to uwzględnianie aspektów etycznych na każdym etapie cyklu życia systemów AI, możliwość powołania komitetu ds. etyki lub wyznaczenie osób odpowiedzialnych za nadzór etyczny nad AI, a także regularne oceny wpływu etycznego, które pozwolą ocenić potencjalne konsekwencje społeczne i dla praw człowieka wynikające z zastosowań AI w HR.

Ciągłe monitorowanie i audyt

Wdrożenie systematycznego monitorowania i audytów systemów AI jest niezbędne, aby zapewnić ich zgodność i etyczne działanie w dłuższym okresie. Obejmuje to regularne monitorowanie skuteczności i dokładności algorytmów, audytowanie systemów pod kątem potencjalnych uprzedzeń i wyników dyskryminacyjnych oraz zapewnianie ciągłej zgodności z RODO i AI Act.

Jakość danych i uprzedzenia algorytmiczne

Priorytetem powinno być dbanie o jakość danych i proaktywne przeciwdziałanie uprzedzeniom algorytmicznym. Oznacza to zapewnienie, że dane używane do trenowania systemów AI są trafne, reprezentatywne i wolne od błędów oraz uprzedzeń, wdrażanie solidnych procedur zarządzania danymi w celu utrzymania ich jakości, a także stosowanie technik wykrywania i ograniczania stronniczości w algorytmach.

Zaangażowanie pracowników

Budowanie otwartej komunikacji i aktywne angażowanie pracowników w proces wdrażania AI może zwiększyć zaufanie, zmniejszyć opór i sprzyjać skuteczniejszej implementacji. Obejmuje to informowanie pracowników i ich przedstawicieli o wykorzystaniu AI w miejscu pracy, dawanie im możliwości zadawania pytań i zgłaszania obaw, a także zbieranie opinii na temat wdrożeń AI.

Zakończenie: Wdrażanie AI w europejskim HR z pewnością i zgodnością z prawem

Integracja sztucznej inteligencji w europejskich działach HR stanowi transformacyjną szansę na zwiększenie efektywności, personalizację doświadczeń pracowników oraz wspieranie strategicznego zarządzania talentami. Jednak wykorzystanie tego postępu technologicznego wymaga dogłębnego zrozumienia europejskich ram regulacyjnych, w szczególności RODO i nadchodzącego AI Act. Menedżerowie HR muszą dostrzegać kluczowe znaczenie dostosowania inicjatyw AI do standardów prawnych i etycznych, aby budować zaufanie pracowników oraz zapewnić długoterminowy sukces wdrożeń.

Do najważniejszych kwestii, na które powinni zwrócić uwagę menedżerowie HR, należy dokładne zrozumienie podejścia AI Act opartego na analizie ryzyka oraz obowiązków związanych z systemami zakazanymi i wysokiego ryzyka – obejmujących w większości podstawowe funkcje HR. Priorytetem jest także zapewnienie ciągłej zgodności z zasadami RODO, zwłaszcza w zakresie podstaw prawnych przetwarzania danych, prawa do niepodlegania decyzjom opartym wyłącznie na automatycznym przetwarzaniu, obowiązku przeprowadzania DPIA oraz wdrażania solidnych mechanizmów bezpieczeństwa danych. Kluczowe znaczenie mają strategiczne inwestycje w zgodne z regulacjami technologie AI, kompleksowe szkolenia dla specjalistów HR, ekspertyza prawna i compliance oraz solidna infrastruktura bezpieczeństwa danych.

Ponadto liderzy HR muszą proaktywnie mierzyć się z wyzwaniami i ryzykami związanymi z AI, w tym z potencjalnymi uprzedzeniami algorytmicznymi, koniecznością nadzoru człowieka oraz potrzebą zapewnienia sprawiedliwości, odpowiedzialności i przejrzystości. Otwartość komunikacyjna i aktywne zaangażowanie pracowników są niezbędne, aby budować zaufanie i łagodzić obawy związane z utratą miejsc pracy czy prywatnością.

Przestrzegając najlepszych praktyk – takich jak opracowywanie jasnych polityk wewnętrznych, tworzenie etycznych ram zarządzania, wdrażanie ciągłego monitorowania i audytu, priorytetyzacja jakości danych oraz promowanie otwartej komunikacji – europejscy menedżerowie HR mogą z pełnym przekonaniem wykorzystywać potencjał AI, jednocześnie wypełniając swoje zobowiązania prawne i etyczne. Ciągłe uczenie się, dostosowywanie do zmieniających się regulacji oraz podejście skoncentrowane na człowieku będą kluczem do pełnego wykorzystania potencjału tej technologii w kształtowaniu przyszłości pracy w Europie.